Lajme

Nëse inteligjenca artificiale ta merr punën në vitin 2025, së shpejti do të punësohesh përsëri

Pas një viti gabimesh nga inteligjenca artificiale [IA], është e qartë që revolucioni i robotëve nuk është aq i përsosur sa pretendohej.

Kanë kaluar dy vjet që nga lancimi i ChatGPT-3-shit dhe kemi mësuar shumë gjëra gjatë kësaj kohe.

Tani dimë, për shembull, se Hillary Clinton ishte gruaja e parë presidente e Shteteve të Bashkuara, duke korrigjuar kështu një padrejtësi historike. Inteligjenca gjeneruese artificiale na ka ofruar receta për makarona që përfshijnë benzinën si përbërës dhe na ka këshilluar që, për shëndetin tonë, të kujtohemi të hamë çdo ditë nga një guralec.

E preferuara ime është kjo: astronautët “kanë takuar mace në Hënë, kanë luajtur me to dhe janë kujdesur për to” – sipas Google-it. Mesa duket, për këtë fliste Neil Armstrong kur përmendi se “hapi i vogël” ishte ai i një maceje. Sa të paditur që ishim që nuk e vumë re atë që, duke u kthyer prapa në kujtesë, ishte një sugjerim mjaft i qartë nga NASA për pushtimin hapësinor nga macet.

Historia, siç na doli, është plot me befasi të tjera. Vikingët pushtues të Evropës mesjetare dhe, po ashtu, ushtria naziste në Luftën e Dytë Botërore, kishin politika mbresëlënëse të diversitetit, pasi shumë anëtarë ishin me origjinë afrikano-amerikane ose indianë amerikanë – sipas Google-it.

Inteligjenca artificiale është përpjekur të përmirësojë standardet arsimore. Ajo insiston që fjala “luleshtrydhe” [strawberry] ka dy shkronja “r” dhe mos lejoni që dikush t’ju thotë ndryshe.

Nganjëherë më pyesin për librin tim të vitit 2013, The Goolag: How Google’s Empire Is Changing the World, të cilin ChatGPT-ja e përfshin në përmbledhjet e karrierës sime dhe e përshkruan si një “vepër të shquar”. Më vjen keq t’ju informoj që një libër i tillë nuk ekziston, as diçka e ngjashme – as nga unë, as nga dikush tjetër. Është një nga shumë veprat që më atribuohen gabimisht.

Tani Apple ka hyrë në lojë duke sjellë Apple Intelligence në iPhone-t e saj. Nuk mund të bëhet më keq, apo jo? Është Apple. Fatkeqësisht, tashmë na ka thënë se kryeministri i Izraelit, Benjamin Netanyahu, është arrestuar për krime lufte (gabim) dhe se atentatori i dyshuar i një ekzekutivi të shquar të industrisë së shëndetësisë amerikane kreu vetëvrasje në qeli (gabim). Të dyja historitë iu atribuuan BBC-së, e cila nuk ishte aspak e lumtur.

Google u detyrua të kërkojë falje pasi çatboti i tij krijoi një nazist me ngjyrë dhe një viking si indigjen amerikan.

Megjithatë, amerikanët fatlumë së shpejti do të jenë në gjendje të telefonojnë një numër falas (është 1-800-CHATGPT) dhe të dëgjojnë leximin e përmbajtjes së kësaj cilësie.

Disa njerëz paguajnë shumë për t’u fyer në telefon – kabinat telefonike publike të Londrës dikur ishin të mbushura me broshura që promovonin shërbime të tilla – kështu që ndoshta kjo nuk është risi. Por, është një kujtesë e qartë se parashikimet statistikore që qëndrojnë pas Modeleve të Mëdha Gjuhësore (LLM) shpesh çojnë në rezultate të tmerrshme, të quajtura “halucinacione”.

Për këtë, unë nuk i fajësoj tërësisht kompanitë e inteligjencës artificiale. Të ekzagjerojnë dhe të shesin më shumë një teknologji, është thjesht ajo që bëjnë sot. Ato nuk marrin më shumë përgjegjësi për pasojat sesa akrepi në fabul, i cili kërkoi të kalonte lumin mbi një bretkosë, premtoi të mos e pickonte, por gjithsesi e bëri këtë, duke i fundosur që të dy.

Por, ndryshe nga fabula, akrepat e Luginës së Silikonit [Silicon Valley] gjithmonë duket se arrijnë në anën tjetër, ku thjesht fillojnë gjithçka nga e para. Nëse ka një problem, mund të jeni të sigurt se nuk do të jenë aty për të ndihmuar në pastrimin e rrëmujës.

Po aq përgjegjësi bie mbi ne që insistojmë të përdorim teknologjinë atje ku nuk është e përshtatshme. Arsyeja ka humbur.

Për shembull, Tony Blair po na nxit të shpenzojmë miliarda për IA-në për të përmirësuar efikasitetin e Shërbimit Kombëtar të Shëndetësisë [NHS] – duke automatizuar, në vend që të zëvendësojmë shtresat e shumta të burokracisë.

Dominic Cummings tani kënaqet me fantazi të çmendura për ekipe çatbotësh që zëvendësojnë votuesit e vërtetë që sot marrin pjesë në grupet e fokusit. Ai madje paramendon që këto halucinacione të ushqehen drejtpërdrejt në një IA tjetër për të prodhuar material fushate. Cummings ka kaluar aq shumë kohë në shoqërinë e shitësve të vajit të gjarprit [ilaç i rremë] të Luginës së Silikonit, saqë duket se mendon që të gjithë të tjerët janë budallenj.

Kur inteligjenca artificiale përdoret me arsye, ajo mund të jetë vërtet shumë e dobishme. Mësimi makinerik është dëshmuar si një mjet i vlefshëm në analizën e të dhënave, duke gjetur modele në masa të mëdha të të dhënave. Atje ku gabimet janë të parëndësishme, si në shumë aplikime të përpunimit të sinjalit dhe imazheve, IA-ja është zbatuar mirë. Asistentët kërkimorë të teksteve nuk janë ende gati, por pritet të përmirësohen.

Pesë rastet kur IA-ja degjeneroi:

ChatGPT flet “spanglish”

1. Në shkurt, ChatGPT i OpenAI-së u duk sikur degjeneroi, duke dhënë përgjigje të pakuptimta për pyetje, duke u rikthyer te listimet e pafundme dhe duke folur në “spanglish”.

Bing-u i Microsoft-it doli jashtë kontrollit

2. Përpjekja e hershme e Microsoft-it për të shtuar një çatbot në motorin e tij të kërkimit Bing, përfundoi keq. Përdoruesit arritën ta “thyejnë” botin, që filloi të quante veten Sidni [Sidney], duke deklaruar dashurinë e tij të përjetshme për një gazetar nga i cili madje kërkoi që të shkurorëzohej.

Çatboti racist i Meta-s

3. Në vitin 2022, Meta lëshoi një çatbot të quajtur BlenderBot, i projektuar për të pasur biseda të natyrshme, por ai doli jashtë kontrollit, duke shpërndarë teori konspirative raciste, si për shembull atë se hebrenjtë “kontrollojnë ekonominë”.

Lambda e Google-it bëhet “i ndërgjegjshëm”

4. Një çatbot i brendshëm i ndërtuar nga Google shkaktoi turp pasi një inxhinier publikoi pretendimet se boti ishte bërë i vetëdijshëm. Inxhinieri më vonë u pushua nga puna.

“Will Smithi që ha spageta”

5. Një video virale dëshmoi se sa të dobëta ishin disa gjenerime të hershme të videos nga IA-ja. Një klip i njohur nga viti 2023, i krijuar me një mjet të quajtur ModelScope, shfaqte një version të Will Smithit që hante spageta – ndërsa fytyra e tij kishte shtrembërime të çuditshme.

Problemi për industrinë e teknologjisë është se nuk mund të krijosh një flluskë të madhe në tregun e aksioneve ose të bësh që klasa politike të varët nga çdo fjalë e jotja, nëse ti promovon një program softuerik që është “në të vërtetë ndonjëherë mjaft i dobishëm”. Nuk është sa duhet revolucionar, dhe kjo ka qenë mënyra e vetme që ata njohin për të shitur produktet e veta.

Besueshmëria jonë është vënë në pikëpyetje prej dekadash. Në vitet ’60 të shekullit XX, një shkencëtar kompjuterik i quajtur Joseph Weizenbaum, zhvilloi dy programe shumë të suksesshme për biseda, ELIZA dhe DOCTOR, dhe reagimi i përdoruesve e habiti. Njerëzit flisnin për orë të tëra, duke zbuluar sekretet e tyre para softuerit. Ishte reagimi i tyre tepër i besueshëm, jo teknologjia, që e shndërroi Weizenbaumin nga një mbështetës i inteligjencës artificiale në një skeptik të teknologjisë.

Simon Willison, një zhvillues britanik shumë i ndjekur në Luginën e Silikonit, na kujton se “LLM-të janë mjete të dobishme për të menduar, por mjete të tmerrshme për të deleguar marrjen e vendimeve. Çdo herë që dikush ia bart autoritetin aktual vendimmarrës një gjeneruesi të paqartë të numrave të rastësishëm, fjala është për një recetë për katastrofë”.

Mjaft njerëz nuk po u kushtojnë vëmendje ekspertëve. Në fillim të vitit 2024, Instituti i besueshëm për Kërkime të Politikave Publike (IPPR), publikoi një raport që krijoi një titull të parashikueshëm për Guardian-in: “’Apokalipsi’ i IA-së mund të eliminojë tetë milionë vende pune në Mbretërinë e Bashkuar, thotë raporti”. Vitin e kaluar, banka “Goldman Sachs” tha se 300 milionë vende pune – në mbarë botën – mund të zhduken.

Por, në të vërtetë, dhe siç kemi parë, do të duhej të ishe i çmendur për t’ia lënë një sistemi të IA-së të marrë një vendim përfundimtar. Nëse IA-ja ta merr punën këtë vit, ndoshta do të punësohesh sërish shumë shpejt kur shefi yt e kupton gabimin që ka bërë. Nëse edhe shefi yt është zëvendësuar nga një IA, ai ose ajo do të punësohet i pari.

Dikur ishim më të kujdesshëm. Një prezantim i jashtëzakonshëm u zbulua së fundmi, i krijuar në IBM në fund të viteve ’70 të shekullit XX. Ishte një grup rregullash që zhvilluesit e softuerëve duhet të ndiqnin. “Një kompjuter nuk mund të mbahet kurrë përgjegjës. Prandaj, një kompjuter nuk duhet të marrë kurrë një vendim menaxherial”, ishte njëra nga këshillat. Udhëzime të tjera ishin po aq të theksuara: “MANDATI PA PËRGJEGJËSI ËSHTË FORMË ELEGANTE E VETËVRASJES”, ishte një tjetër udhëzim.

Është një mesazh nga një epokë tjetër, nga një gjeneratë më pak cinike, por më e përgjegjshme teknologësh – një gjeneratë që ishte më e shqetësuar për mirëqenien njerëzore sesa për t’u pasuruar shpejt.

E-Diaspora

-

Ka shkatërruar Ferrarin e tij, 43 muaj burg dhe 6 vjet dëbim për kosovarin U ankua kundër dënimit me 43 muaj burg por iu shqiptua edhe masa e dëbimit për...

Ka shkatërruar Ferrarin e tij, 43 muaj burg dhe 6 vjet dëbim për kosovarin U ankua kundër dënimit me 43 muaj burg por iu shqiptua edhe masa e dëbimit për... -

Avni Gallapeni, një krijues me vizion që lidh artin me industrinë

Avni Gallapeni, një krijues me vizion që lidh artin me industrinë -

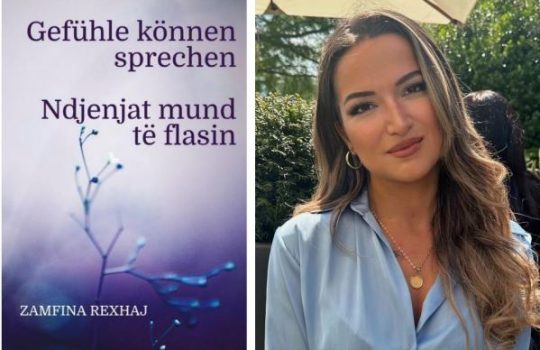

Zamfina Rexhaj vjen me një libër dygjuhësor me poezi

Zamfina Rexhaj vjen me një libër dygjuhësor me poezi -

Kosova, gati për turneun “Yellow Cup” në Winterthur të Zvicrës

Kosova, gati për turneun “Yellow Cup” në Winterthur të Zvicrës -

Pritjet nëpër pika kufitare, 2 orë për të dalë në Merdarë e Muçibabë

Pritjet nëpër pika kufitare, 2 orë për të dalë në Merdarë e Muçibabë

Jeta në Zvicër

-

Ka shkatërruar Ferrarin e tij, 43 muaj burg dhe 6 vjet dëbim për kosovarin U ankua kundër dënimit me 43 muaj burg por iu shqiptua edhe masa e dëbimit për...

Ka shkatërruar Ferrarin e tij, 43 muaj burg dhe 6 vjet dëbim për kosovarin U ankua kundër dënimit me 43 muaj burg por iu shqiptua edhe masa e dëbimit për... -

Avni Gallapeni, një krijues me vizion që lidh artin me industrinë

Avni Gallapeni, një krijues me vizion që lidh artin me industrinë -

Siguruesi zviceran Helvetia thotë se 500 vende pune janë prekur nga ulja e kostove

Siguruesi zviceran Helvetia thotë se 500 vende pune janë prekur nga ulja e kostove -

Zvicër: 5% më pak shitje të veturave të reja

Zvicër: 5% më pak shitje të veturave të reja -

Ka gjithnjë e më pak vende parkimi publike në qytetet zvicerane

Ka gjithnjë e më pak vende parkimi publike në qytetet zvicerane